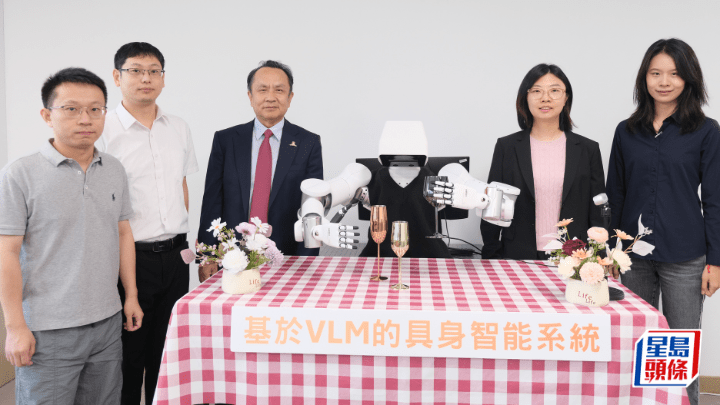

中大研「眼看手模」机械人 模拟人类3D空间认知

发布时间:17:35 2026-04-30 HKT

机械人虽可理解人类的语言指令,但对物体之间的三维空间关系缺乏深入认知。中文大学工程学院团队成功研发具空间智能的视觉语言大模型(Vision-Language Models, VLM)技术,让机械人能像人类一样理解三维空间资讯,结合视觉及触觉传感器数据,令机械人可模拟人类「眼看手摸」的协作方式,自主完成各项复杂长序列的操作任务。研究成果已于国际知名期刊《Science Robotics》刊登。

让机械人有能力执行复杂任务

中大与加州大学伯克莱分校教授组成的研究团队,提出名为「检索增强操作」(Retrieval-Augmented Manipulation,RAM)的新方法,使机械人在规划操作任务过程中,能同时回答「每一步该做什么」及「在三维空间中怎样做才可行」两个关键问题,并为机械人建构了三维物件知识库,记录日常生活常见物件的三维几何形状、摆放方式及可抓取部位。当VLM在生成操作计划时,可即时从知识库检索物体的几何与操作纪录,评估及判断实际可行的操作序列,将抽象指令转化为准确的空间描述,让AI机械人有能力执行复杂任务。

延伸阅读:中大团队揭月球内部水资源新线索 玻璃珠研究颠覆传统认知

新方法有效突破大模型在语言理解及推理能力的局限,将AI拓展至复杂的三维物理操作场景。负责研究的计算机科学与工程学系副教授窦琪指,赋予机械人空间智能是提升机械人执行复杂操作能力的关键,视觉感知是实现空间智能的重要环节。在目前涵盖的31个不同物体的14项空间感知操作任务中,RAM可让机械人精确执行空间语言指令、推理三维空间关系,以及根据场景物理条件,作出自适应操作。新技术更可搭配现时市面通用的VLM使用,并可应用于通用的人形机械人平台,完成精细化且复杂的操作任务。

延伸阅读:中大校长卢煜明 获美国癌症研究协会颁发「杰出讲座奖」

中大新研发的系统更具备视触融合的可扩展性,兼容触觉反馈以增强机械人的自适应操作能力。中大卓敏机械与自动化工程学教授兼香港物流机械人研究中心(HKCLR)总监刘云辉指,研究展示AI技术在提升机械人操作能力的巨大潜力,在工业和家庭等不同场景具广泛的应用前景,有助进一步改善人类生活。

本报记者

诚邀大家做问卷调查,话俾我哋知你对《星岛教育》有咩意见!连结:>>按此<<