每日杂志|动物卡通藏血腥剧情 ASMR伪疗愈现露骨暗示 AI问题影片泛滥 专家忧影响儿童心智

发布时间:08:00 2026-01-02 HKT

在生成式人工智能(Gen AI)普及的时代,社交平台涌现大批以可爱动物卡通及自主感觉受讯反应(ASMR)为包装的AI影片,实则暗藏暴力与色情资讯,恐成为AI版「Elsagate」。这类内容透过演算法精准推送,在短时间内录得数以亿计点击,令本地儿童及青少年极易误触陷阱。有社工与临床心理学家指出,创作者利用AI低成本大量生产,以可爱外壳削弱儿童防备心,长远恐导致认知偏差及价值观扭曲,期望透过家校合作等多层面的介入,提高社会警觉。尽管平台设有审核机制,惟有资讯科技界人士关注,技术发展速度远超监管技术更新,促请政府及社会就Gen AI建立规管框架。

近年来,Instagram、YouTube等主流社交平台上出现大量以Gen AI制作的不当影片。这类影片多以「儿童友善」作为包装,利用可爱的动物卡通吸引儿童及青少年观众,实际内容却暗藏暴力、性暗示,甚至错误资讯。

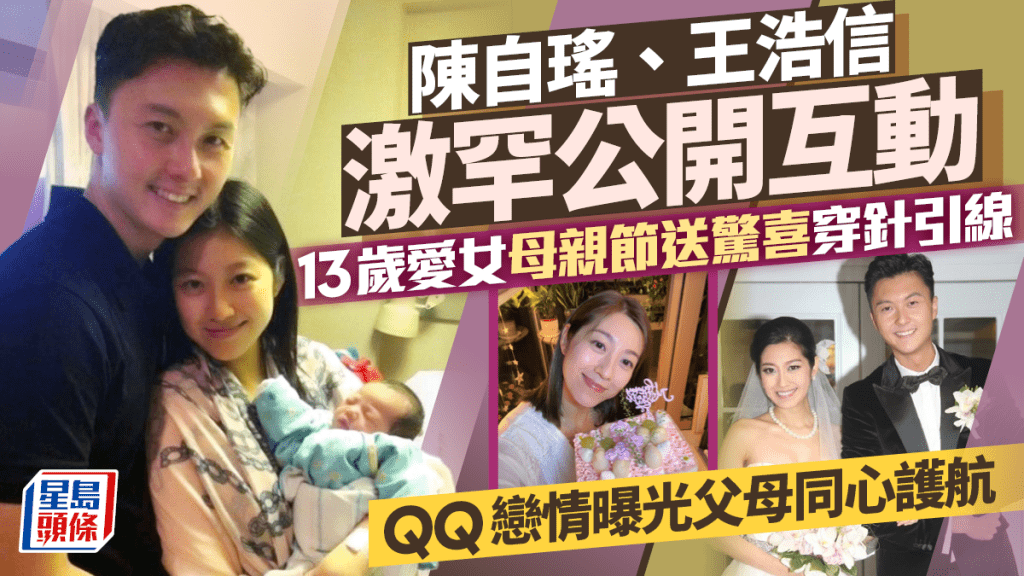

以部分高点赞的动物卡通影片为例,影片开头呈现一只外型讨喜的黄色猫咪,但至中段时,该猫咪却用平底镬偷袭一只猪,并将其烹煮;甚至有母猫与其他动物发生不伦关系,其幼猫因察觉异常被关进兽笼,遭恶狗撕咬等剧情,充满性与暴力暗示。

相关频道观看量破亿

常被视作疗愈的ASMR影片同样存在陷阱,部分影片虽标注为「雨声」,画面却是一名年长男子,将手放在年轻女子胸部的露骨肢体接触。

翻查多个提供此类影片的频道,不少均为近年开设。有去年4月建立的频道,上载逾128部影片,已累积超过5000万观看次数;另有前年底创建的频道,仅发布45部影片,观看量却达到惊人的37亿次。根据记者实测,YouTube Kids应用程式会屏蔽部分涉及上述问题的频道或影片,但在一般的YouTube网页仍可轻易搜寻到,意味着未成年人仍有机会接触到这些不当资讯。

香港互联网协会开放数据小组召集人黄浩华表示,Gen AI的普及令内容生产门槛与成本大幅下降,创作者只需稍作修改文字或情节,便可快速大量生产「踩界」,甚至涉及暴力或儿童色情暗示的影片,并不断测试哪些形式较容易避开平台审查或取得儿童信任。

「有些虐待动物,有些是成人化动作,他们会觉得很奇怪。」家福会网络教育及辅导服务社工文建康亦指出,这类伪装成安全内容的不良影片在本地中小学生中偶尔可见,部分年纪较小的儿童在观看后,情绪上受到影响,出现惊恐、不安,甚至失眠等反应。

他表示,儿童较容易被影片的色彩、声音与节奏吸引,往往将之误认为正常娱乐,未能即时意识到内容的不妥;至于青少年,则较多是在明知内容不良的情况下,因朋友分享或观看「禁片」的刺激感而接触。他形容,影响未必会即时反映在行为上,但长远可能削弱儿童及青少年对暴力或色情内容的警觉,使「见惯不怪」逐渐成为常态,影响价值观的形成。

长远恐导致认知偏差

然而,不少家长对此类风险认知不足。文建康指,普遍家长仍将卡通或动物影片视为安全内容,监管焦点多放在观看时间、网络诈骗风险及会否影响学业上,低估了内容本身的风险。他忆述,过往举办相关讲座时,家长们对社交平台存在这类影片感到惊讶,「他们觉得平台应该有人会负责审核,但我们的活动也维持了2年,用作教材的影片才被YouTube下架」。

临床心理学家梁重皿指出,当暴力或色情信息以亮丽、夸张的卡通形式呈现时,儿童难以将眼前可爱的形象与从社会及家庭所学到的危险讯息挂钩,容易产生认知混淆,削弱他们对危险资讯的判断力。短期或会引发恶梦、情绪困扰,甚至警觉性过度提高;若持续接触,则可能降低对暴力或性暴力的敏感度,对同理心的发展及人际关系的理解产生偏差。

她亦提醒,人类透过观察与模仿来学习行为,若影片中的暴力行为未触发儿童的惊吓反应,他们极可能在不知不觉中模仿相关动作,降低道德上的抑制能力。

问到平台审核是否存在漏洞,黄浩华表示,现时不少影片在开首刻意包装成人畜无害的动物卡通、ASMR或日常内容,到中后段才逐渐出现令人不安的情节。在面对这种将有害资讯隐藏在影片中后段的混合式内容时,传统的审核方式过于依赖用户举报、电脑视觉或自然语言处理(NLP),难以单凭单一画面或关键字即时判断,反应往往显得滞后。

家校介入建立学生判断力

此外,演算法亦不再只是被动回应,而是主动探索用户可能感兴趣的领域,一旦不慎接触到不适当内容,要完全「洗走」并不容易,只能透过标示不感兴趣、举报或封锁创作者等方式逐步修正,「前提是小朋友要有足够的危机意识才能做到。」

面对隐蔽性强、扩散速度快的AI威胁,黄浩华认为需结合技术拦截、法律规管与家庭教育,才能为儿童构建一道安全的网络防线。他指出,在海量内容的现实下,无论是人工审核还是技术部署,都面临庞大的营运压力,惟平台在儿童保护上的角色与责任,仍有需要更为主动。此外,香港目前并无专门针对Gen AI的法律,多依赖《防止儿童色情物品条例》或一般刑事罪行法例作底线约束,建议社会需就建立更明确的规管框架作更多讨论。

梁重皿建议,家长宜投入更多时间陪伴子女观看内容,了解他们实际接触的是甚么影片,并在共同观看过程中引导子女分辨角色行为是否合理,鼓励他们主动分享看过的影片内容。文建康亦建议,学校可进一步推出与时并进的AI辨识及媒体素养课程,协助学生建立基本判断能力。

「亲密接触」野生动物生成影像传播 惹模仿恐造成伤害

随着AI技术的普及,社交媒体上涌现大量制作精美的AI生成动物影像,关注野生动物福利的英国慈善组织Wild Welfare指出,这些看似可爱的AI动物影像,正扭曲大众对野生动物福利的认知,或令现实中的动物处境恶化。

Wild Welfare表示,AI系统无法区分真正的野生行为与受虐情境,许多影像中动物被装扮、束缚或强迫做出不自然动作,仍被视为创作素材,更容易在网络大规模传播,长远或令实际对动物造成极大压力或伤害的行为被「正常化」。

该组织亦关注,网络上广泛流传AI生成的「与野生猫科动物亲密接触」或「与海豚共游」等影片,往往缺乏虚拟内容标签,容易引发大众在现实生活中模仿,间接鼓励游客追求有害的野生动物旅游。

「Elsagate」风波YouTube删除大量问题影片

内地网络近日亦涌现大批以国产经典电视剧为题材的「AI魔改」短片。为整治有关乱象,国家广播电视总局昨起,在全国开展为期1个月的专项治理,并同步清理少年儿童熟知和喜爱的动画形象改编生成的各类「邪典」(不良)动画。类似问题早于2016年在国际平台出现,YouTube当时因「Elsagate」风波被批评,最终展开整顿。

翻查资料,早于2016至2017年间,YouTube大量出现「Elsagate」的问题影片,多以《冰雪奇缘》角色Elsa(爱莎)、蜘蛛侠等儿童熟悉的卡通角色为主角,沿用可爱造型与童话情节,实际夹杂暴力、恐怖、性暗示,甚至模拟危险行为。相关影片往往被标示为适合儿童观看。

面对媒体持续报道及家长投诉增加,YouTube于2017年11月宣布展开清理行动,删除大量可能危害儿童的影片及相关频道,并结合自动和人工举报,封锁未成年人影片中的不当评论等。其后,平台亦加强对创作者的指引与监管,并推出适合家庭观看的平台,加强内容筛选与分类机制,减少不当影片流入儿童观看环境。

记者:潘明卉