AI数据中心用电需求急增

发布时间:03:00 2025-09-12 HKT

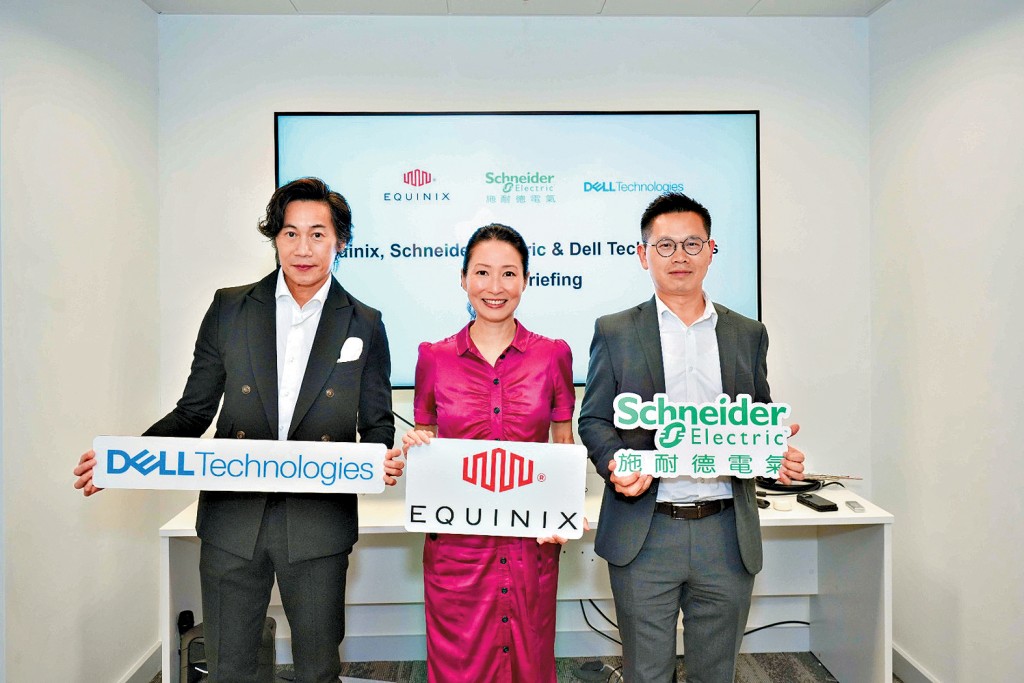

人工智能(AI)不止影响科技格局,同时正在重塑能源市场,主因训练AI和高效能运算需要大量电力,并对全球数据中心的散热功能带来挑战,令液体冷却技术应运而生。数码基础设施公司Equinix最新宣布,与Dell Technologies及施耐德电气合作,于Equinix HK1数据中心利用液体冷却技术,为高功率密度(HPD)的AI运算伺服器降温。

高盛一项研究指出,预计至2027年用电需求将增加50%,而到2030年更可能达到165%增长。另一方面,传统的数据中心散热方式主要依赖风冷系统,利用空调和风扇将热量传递给空气,再将热空气排出或与冷空气混合,例如通过架空地板等方式来分离和引导气流,以达到为设备散热的目的,但这种方式在高热负载的数据中心已显不足。

传统空调系统能源效益极低

施耐德电气香港区总裁赵启文回忆道,20年前自己刚刚入行时,每个机柜的功耗普遍在1.5千瓦左右,到后来慢慢发展至20至30千瓦;而在当今AI运算的情况下,功耗动辄超过100千瓦。他直言,AI只会不断发展,数据中心对高密度运算及高能源效益基础的需求,也只会持续变高。在如此高的密度下,传统电脑机柜空调系统(CRAC)已无法有效将热能带走。

Equinix香港区董事总经理韩祖恩亦表示,传统依赖空气调节的散热方式,在面对现今AI伺服器的高热负载时已渐见樽颈,单纯增加风扇抽风,能源效益极低。

液体传导热量比空气高3000倍

为解决高密度伺服器的散热问题,Equinix与Dell Technologies及施耐德电气合作,尝试在Equinix HK1数据中心设置50千瓦机柜式直达芯片(Direct-to-chip)液体冷却系统。

根据介绍,液体冷却设备每个机柜的冷却容量高达150千瓦,是传统空气冷却系统的30倍。同时由于液体(导热式冷却)能传导的热量比空气高逾 3,000倍,能更直接高效地将伺服器晶片这类核心发热源产生的热能带走。

另外,传统电脑机柜空调(CRAC)系统的电源使用效率(PUE)为1.4至1.5,采用液体冷却技术后,数据中心PUE可降至1.2或更低。据估算,若于数据中心中全面推行液体冷却系统,每座数据中心每年更可节省逾2,000兆瓦时,即200万度电的能源,相当于约500户香港家庭的年用电量。

可应用现有基础建设及扩展

在此次多方合作中,Equinix HK1数据中心安装了Dell的直达晶片液冷伺服器,作为高速运算核心;施耐德电气作为能源基建专家,引进最新的机柜式液体冷却分配装置(CDU)系统,确保AI晶片稳定运作;中华电力则从能源审核及顾问角度,推动业界采纳更节能的方案。

值得注意的是,液冷技术可以直接应用在现有的基础建设当中,毋须大规模改动基建亦可升级。而今次示范就以营运超过20年的Equinix HK1数据中心作为场地,并在一个标准的1.2米深机柜内部署液冷系统;根据介绍,「AI就绪」数据中心方案是全方位且可扩展的,未来可扩展至整个房间、甚至高达2兆瓦的大型独立冷却系统,客户可根据业务增长逐步增加投资,以避免前期不必要的巨大开支。

新建50多个数据中心

另外,韩祖恩指出,在全球新建50多个数据中心,各地客户需求均不一样,而香港客户则主要以金融服务业为主,十分接受液体冷却技术,特别是应付未来AI工作量需求。因此,除了Equinix HK1数据中心会试用此项新技术外,预计Equinix明年第一季落成的数据中心「HK6」,也将会大量采用液体冷却技术的设计。