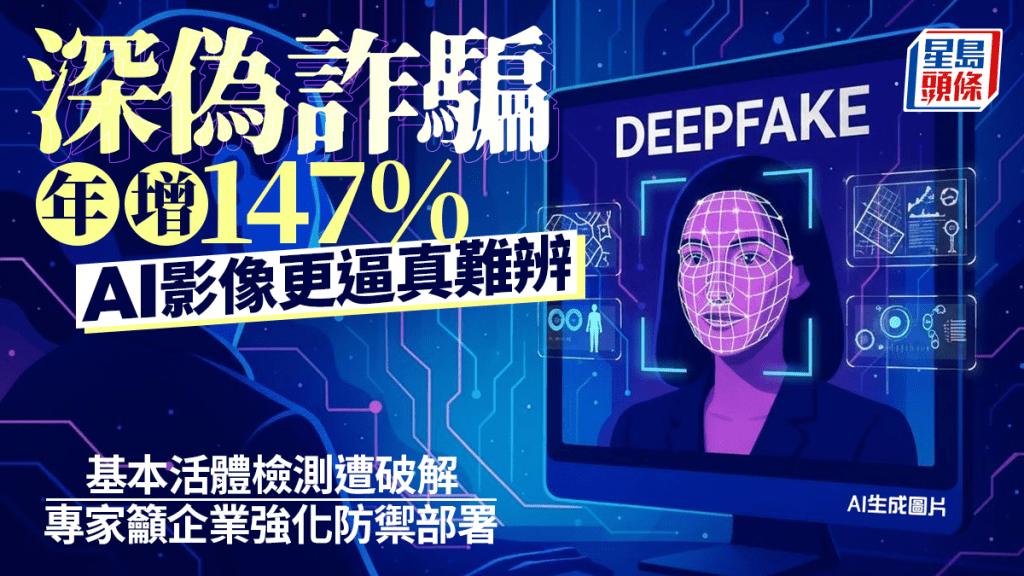

每日杂志|深伪诈骗年增147% AI影像更逼真难辨 基本活体检测遭破解 专家吁企业强化防御部署

发布时间:08:00 2025-11-21 HKT

《AI攻防战系列》之身份诈骗篇

生成式人工智能(AI)的普及令假影像、假声音、假身份在数码社会迅速蔓延,随着深度伪造与合成身份技术被广泛滥用,犯罪活动更具隐蔽性与破坏力。今年本港深伪个案按年增加147%,有专家指出,犯罪分子已可利用AI复制细微动作,突破传统活体检测,难以凭眨眼、转头等简单动作辨识真伪,建议企业应强化AI防御部署,规管工具使用、提升员工警觉性,配合AI驱动的主动及被动验证技术,应对日益复杂的深伪诈骗威胁。

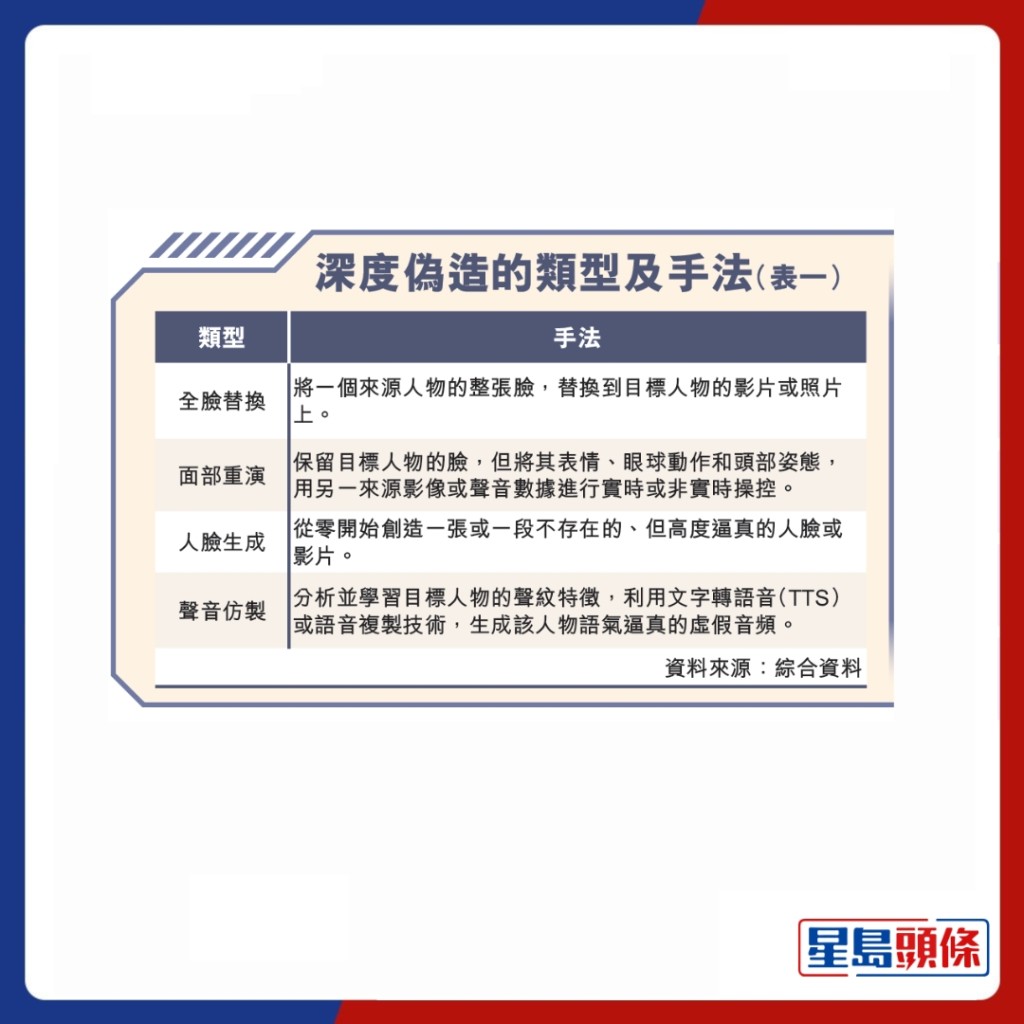

深度伪造(deepfake)利用AI技术将他人的脸、声音或动作精准套入影像素材,制作逼真影片或音讯,用于冒充高层、合作伙伴发动诈骗。早前,一间本港跨国公司职员收到WhatsApp讯息,对方冒充总公司财务总监,疑通过公司公开片段作素材,配合深伪技术篡改说话内容,于视像会议中播放,成功诱骗职员转款近400万元。

全球验证平台Sumsub的数据显示,全球约有一半企业和用户在去年曾遭遇身份欺诈,每宗案件平均损失约30万美元;今年本港深伪欺诈个案按年激增147%。

相关工具使用门槛极低

Sumsub亚太区副总裁Penny Chai表示,随着AI技术进步,骗徒能通过深度伪造与合成身份(synthetic identity)文件等工具,制造逼真的虚假身份,成功绕过传统验证程序,导致帐户被接管、身份盗窃及未经授权交易等问题,「严重损害企业和用户对数码生态系统的信赖。」

「有图有真相」的观念已不再适用,科技大学工商管理学院署理院长许佳龙说,如今AI能生成丰富内容,收到的讯息有照片、影片、声音,也不代表是真人。

记者网上搜寻发现,深伪工具使用门槛极低,毋须技术知识即可操作。部分音讯生成工具如语音复制、变声器及文字转语音,每月仅需约5美元;支援多人视像切换的「换脸」工具起价19.99美元,亦有开源工具可于视像通话中即时换脸。部分平台采免费增值模式,高阶服务每月收费达数百至逾千美元,据指价格越高、效能越强,更难被侦测。

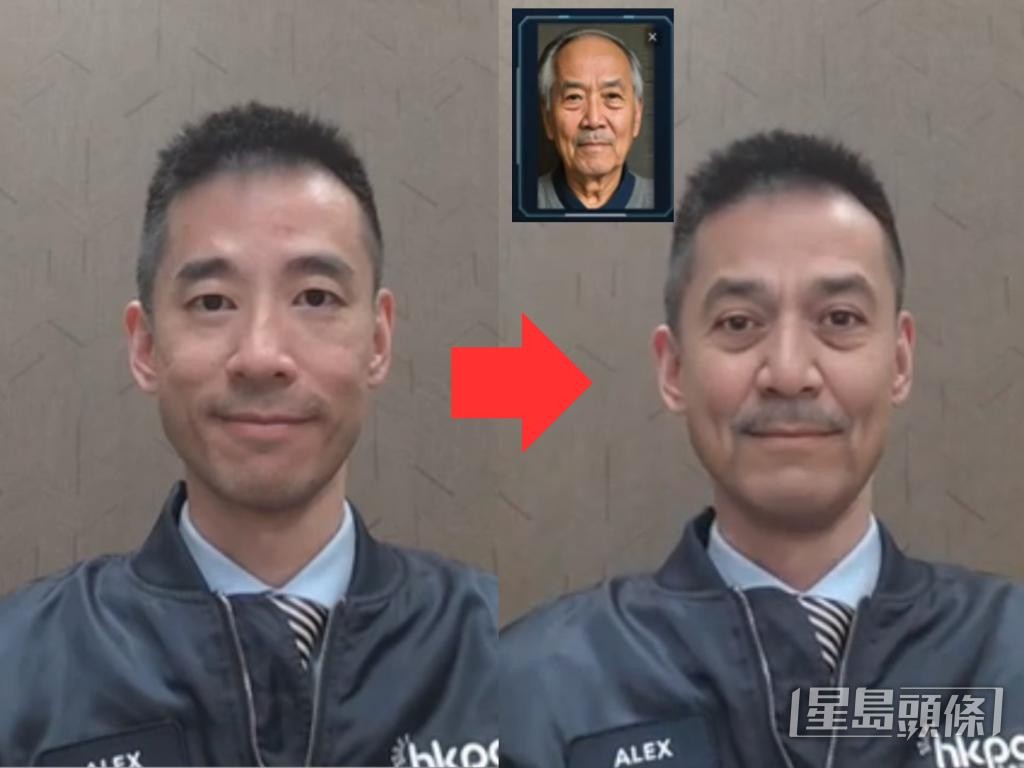

本港不少企业采用「活体检测」作身份验证,但Penny指,基本的活体检测方式(如眨眼或转头)已不再有效,骗徒现已可利用进阶的AI技术复制细微动作,甚至将合成影像直接加入验证流程,「重送攻击(透过撷取并重复使用已通过验证的生物特征数据再次进行验证)、即时人脸替换(实时播放影像中叠加另一张脸部的影像)及注入攻击(植入被篡改的影格或数据)等技术,使简单的动作指令无法有效防范欺诈行为。」

合成身份犯罪「攻击链」隐蔽

近年更广泛出现「欺诈即服务」(Fraud-as-a-Service),诈骗者会将相关技术、工具或流程,以服务形式出售或出租给其他犯罪者,Penny表示,罪犯可轻易使用先进的欺诈工具发动精密型攻击。

骗徒可利用AI将真实资料,如有效的身份证号码或地址,与虚构姓名、照片或其他身份细节结合,创造全新的虚假身份。该类合成身份「看似真实却不存在」,能通过基本验证程序,比完全虚构帐户更难侦测。

根据《Microsoft数位防御报告2025》,微软在过去1年阻止价值40亿美元的诈骗,其中不少由AI驱动,并拒绝了4.9万次虚假合作伙伴注册尝试,平均每小时阻挡160万笔假帐号自动化注册。报告指出,AI生成的身份证件的全球使用量升195%。以LinkedIn等平台为例,有些假帐号使用AI生成头像,进行资料搜集、社会工程诈骗和冒充供应商或业务联络人,与其他企业建立联系,伺机引发针对企业内部的钓鱼或攻击行动。

科大计算机科学及工程学系副系主任郭嵩提到,合成身份的危害在于完整且隐蔽的「攻击链」,骗徒先创造虚假身份,再执行一些正常行为以建立信任,同时调整身份设定和行为模式避开风险标记,最后累积信用后进行诈骗。他说,这种全链路隐蔽性攻击方式使合成身份极具可信度、难以追溯,「对金融机构和信用体系构成长期且深远的系统性风险。」

实际上,本地已出现具规模的合成身份犯罪活动,警方上月破获一个本地诈骗集团,成员利用AI将个人面部特征融合至报失身份证的头像,以假冒他人开设网上银行户口。结果在23次申请中,有19次成功通过身份验证。该集团再以这批户口申请借贷和信用卡,把犯罪得益转至多个傀儡户口,一年间处理的黑钱达1.9亿元。

结合AI防护工具多重验证

许佳龙指,攻击方不断利用AI伪造讯息,而防御方也在开发AI协助用户判断真伪,例如自动分析讯息构造、识别AI生成痕迹等。他表示,现时已有研究与金融科技公司在开发此类AI防护工具,协助客户检测讯息是否可疑,「期待越来越多产品推出市场。」

他提醒,当某一讯息渠道被AI攻破,其可信度会大幅下降,监管层面需重视,鼓励企业与用户建立新的验证方式,如使用「测试问题」来确认对方是否为真实身份持有人。

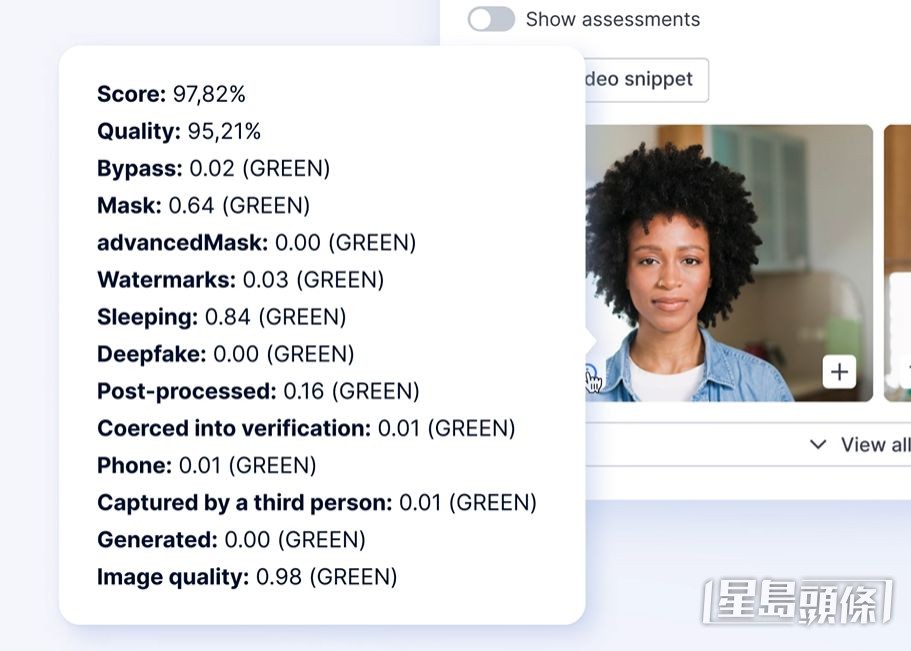

Penny以Sumsub的深伪侦测方案为例,指要应对进阶AI技术,可采用AI驱动的活体侦测技术,以主动与被动验证方式,要求用户执行特定动作,分析像素与识别影像模式,结合神经网络运算,扫描用户脸部、建立3D脸部地图,并运用能即时学习与适应环境变化的演算法侦测深度伪造痕迹。

企业层面亦需重新检视内部流程。微软香港区域科技长许遵发指出,企业应明确规范生成式AI工具的使用权限,强化数据保安设定,持续培训员工AI素养与网络安全意识,主动学习提示工程技巧,警惕诈骗威胁如网络钓鱼、AI语音诈骗和深度伪造,同时保持软件更新及启用多重验证,防止身份盗用和资料外泄。

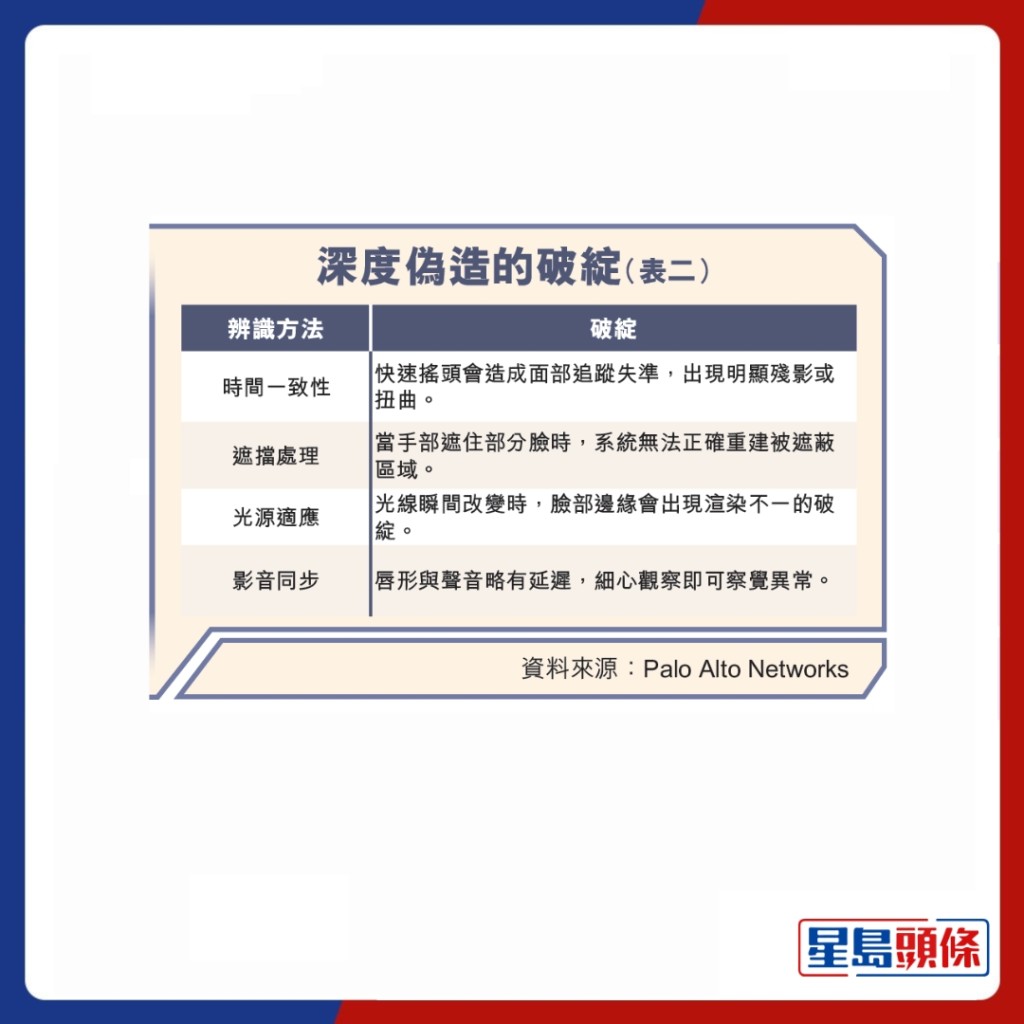

公众教育亦不可或缺,郭嵩提醒,市民需熟悉AI生成内容的迹象,如表情不自然、语音节奏不连贯、语法和逻辑漏洞等,并对过于完美的内容保持警惕。

员工AI制假收据报销 皱折光影几可乱真

外国有企业员工以人工智能(AI)生成假收据报销,为会计带来新挑战。有专家指,企业的防御策略须同步演进。

英国《金融时报》报道,多个金融管理平台近月发现大量AI生成收据,当中皱折、光影与手写签名几可乱真,有平台辨识出价值100万美元的假收据。报道引述平台指,自去年OpenAI的GPT-4o模型推出后,假收据数量明显增加,更有公司识破价值过100万美元的假收据。

Sumsub亚太区副总裁Penny Chai表示,AI让骗徒轻易制作伪冒文件,企业的防御策略必须同步演进,如设备情报分析、欺诈网络侦测系统及善用AI提升准确度与效率,「须定期更新欺诈侦测策略,并安排培训加强员工意识。」

网安顾问:语音深伪已突破「即时性」限制

有网络安全顾问公司测试人工智能(AI)即时语音深伪技术,证实相关技术已突破「即时性」限制。

过去的深伪技术多依赖预录句子或文字转语音,且对硬件有要求,难进行自然对话及有明显延迟。惟据NCC Group近期公开的测试报告指,只需一部普通手提电脑、网上的开源AI模型及常见咪高峰,配以不足5分钟的录音,便可在数小时内训练出语音模型,实现延迟低于半秒的即时语音转换,成本低至一般个人或小型组织可负担。

研究团队在多个实战演练中以该技术取得敏感资讯,诱使受害者更改电子邮件地址、重设密码或执行内部指令。团队亦预期,视像深伪在2年内可突破影音同步与人肌肉动态模拟的限制。

记者:潘明卉、林家希

——

《AI攻防战系列》

传统攻击篇:每日杂志|AI时代网络攻防战升级 低成本客制钓鱼邮件 自动调整攻击模式 专家吁重新审视资安策略