英伟达拟发布全新「推理晶片」 弃用昂贵高频宽记忆体 迎战Google与Meta夹击

发布时间:16:38 2026-03-14 HKT

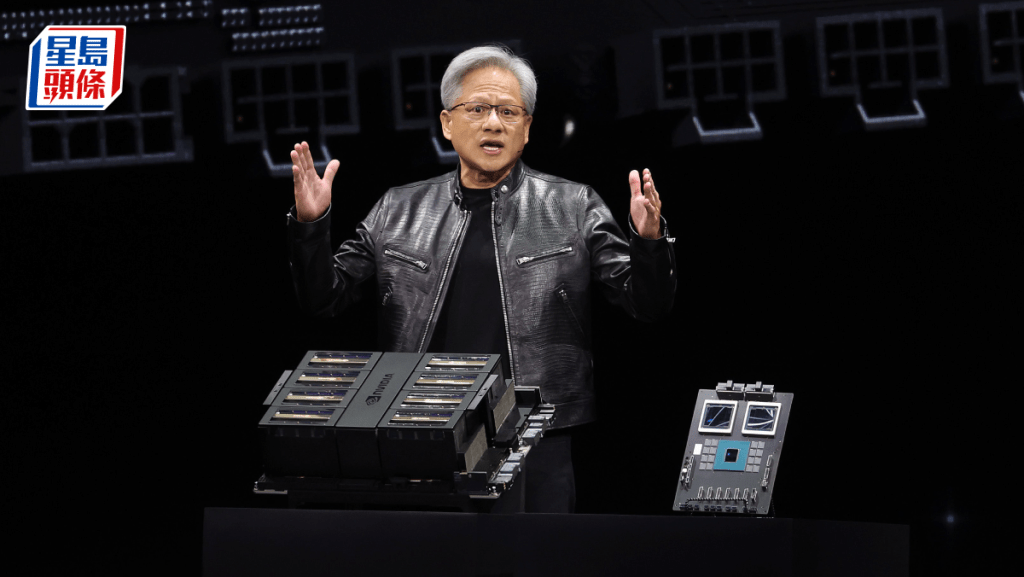

英国《金融时报》引述消息报道,人工智能巨头英伟达(美:NVDA,Nvidia)正准备在即将举行的「GTC 2026」年度开发者大会上,发布一款专为加速AI回应而设计的全新晶片,此举意味Nvidia将打破长期以来以单一处理器应对多种任务的策略。消息指,这款新晶片将专注于AI「推理」(Inference)阶段(即运行而非训练模型),亦是Nvidia去年12月斥资200亿美元(约1,566亿港元)收购初创公司Groq核心团队及技术后,首款亮相的新产品。

首推Groq技术晶片 专攻AI推理市场

报道指,Nvidia计划推出这款基于Groq技术的语言处理器(LPU),与即将推出的旗舰级Vera Rubin GPU协同工作,旨在迎击竞争对手及应对新型的AI应用。

Nvidia目前正面临初创公司及Google等大客户自研AI晶片的挑战;竞争对手Meta日前亦宣布推出新一代专为推理任务而设的四款处理器。有矽谷创投基金投资者直言:「我们正进入一个不再由英伟达独霸的有趣阶段。」

报道指,过去三年,英伟达庞大的市值主要得益于其GPU成为生成式AI产业的支柱,用于训练如OpenAI的ChatGPT等模型。

Nvidia行政总裁黄仁勋过往一直主张,单一系统既可用于训练新AI模型,也可以用于运行基于这些模型建构的聊天机器人和编码工具。尽管各大型科技巨头已投入数以千亿美元部署这些系统,但同时亦投资研发自家的专用AI晶片。另外,随AI工具的日益复杂,例如智能体,或迫使黄仁勋放弃「单一处理器应对多种任务」的理念。

弃用昂贵HBM 改用SRAM降成本

据悉,英伟达现有的Blackwell及即将推出的Rubin系统,均高度依赖价格高昂且供应短缺的高频宽记忆体(HBM)。不过,这款融合Groq技术的新晶片将一改传统,改用静态随机存取记忆体(SRAM),而非HBM所使用的动态随机存取记忆体(DRAM)。由于SRAM在市场上的供应相对充裕,加上技术特性上更适合用于加速AI的「推理」任务,料可大幅提升运算效率及控制成本。

美银料2030年推理开支占比达75%

随著AI技术日益普及,市场对推理运算的需求正急速增长。美国银行分析师估计,到2030年,当全球AI数据中心市场规模达到约1.2万亿美元(约9.36万亿港元)时,推理应用的相关开支将占整体支出的75%,远高于去年的约50%,反映该领域势将成为各大科企的兵家必争之地。