DeepSeek论文提新框架 减低训练AI能源需求 传最快农历新年期间登场

更新时间:09:59 2026-01-02 HKT

发布时间:09:59 2026-01-02 HKT

发布时间:09:59 2026-01-02 HKT

据彭博报道,中国AI初创企业DeepSeek发布最新论文,提出一种名为「流形约束超连接」(Manifold-Constrained Hyper-Connections)的全新框架,该设计旨在提升AI系统扩展性,同时降低训练AI系统的计算和能源需求。

新架构减能耗 提升训练稳定性

DeepSeek透过开放储存库arXiv及开源平台Hugging Face发布该论文,由创办人梁文锋联同18名研究人员共同撰写。论文指出,新框架针对AI训练不稳定及扩展性有限等挑战,融入「严格的基础设施优化」以确保效率。团队在30亿至270亿参数的模型上进行测试,并称该技术有望推动基础模型的进化。

市场预计,DeepSeek即将发布代号「R2」的旗舰模型,或在今年2月的农历新年期间推出。彭博分析指,虽然Google的Gemini 3近期表现强势,但DeepSeek即将推出的「R2」仍有潜力再次颠覆全球AI行业。目前在LiveBench全球大型语言模型(LLM)排名中,中国的低成本模型已占据前15名中的两席。

最Hit

5大最潮湿屋苑!? 电器店抽湿机销售数据揭秘 将军澳日出康城、大埔富蝶邨上榜 第一位「断层式」领先 居民有同感:畀水浸住咁

2026-03-05 11:32 HKT

绕场一周|公益慈善伙伴大奖

2026-03-05 11:15 HKT

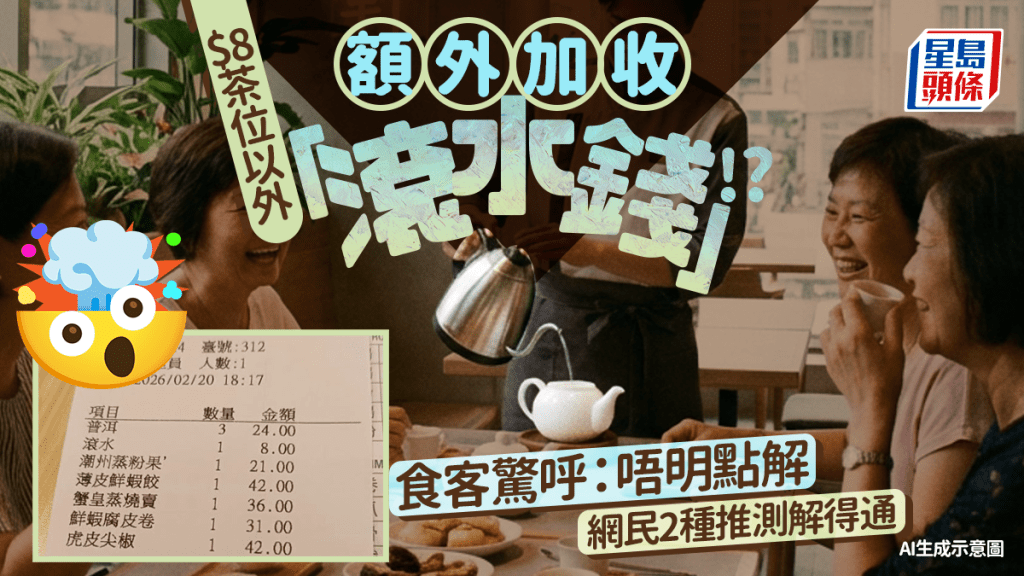

茶楼饮茶收完「茶位费」再收「滚水费」? 食客结帐不解 引网民猜测「咁样计」...

2026-03-05 16:51 HKT