生成式AI有几安全?私隐风险与企业保障全面睇|Nora Tam

发布时间:06:00 2025-06-20 HKT

近年生成式AI大行其道,不少人纷纷将照片转换成不同风格的卡通图像,一秒变身动画角色或电影主角。透过AI技术,几十秒内就能生成逼真又有趣的照片。然而,你又有否细阅过这些应用程式的私隐条款?

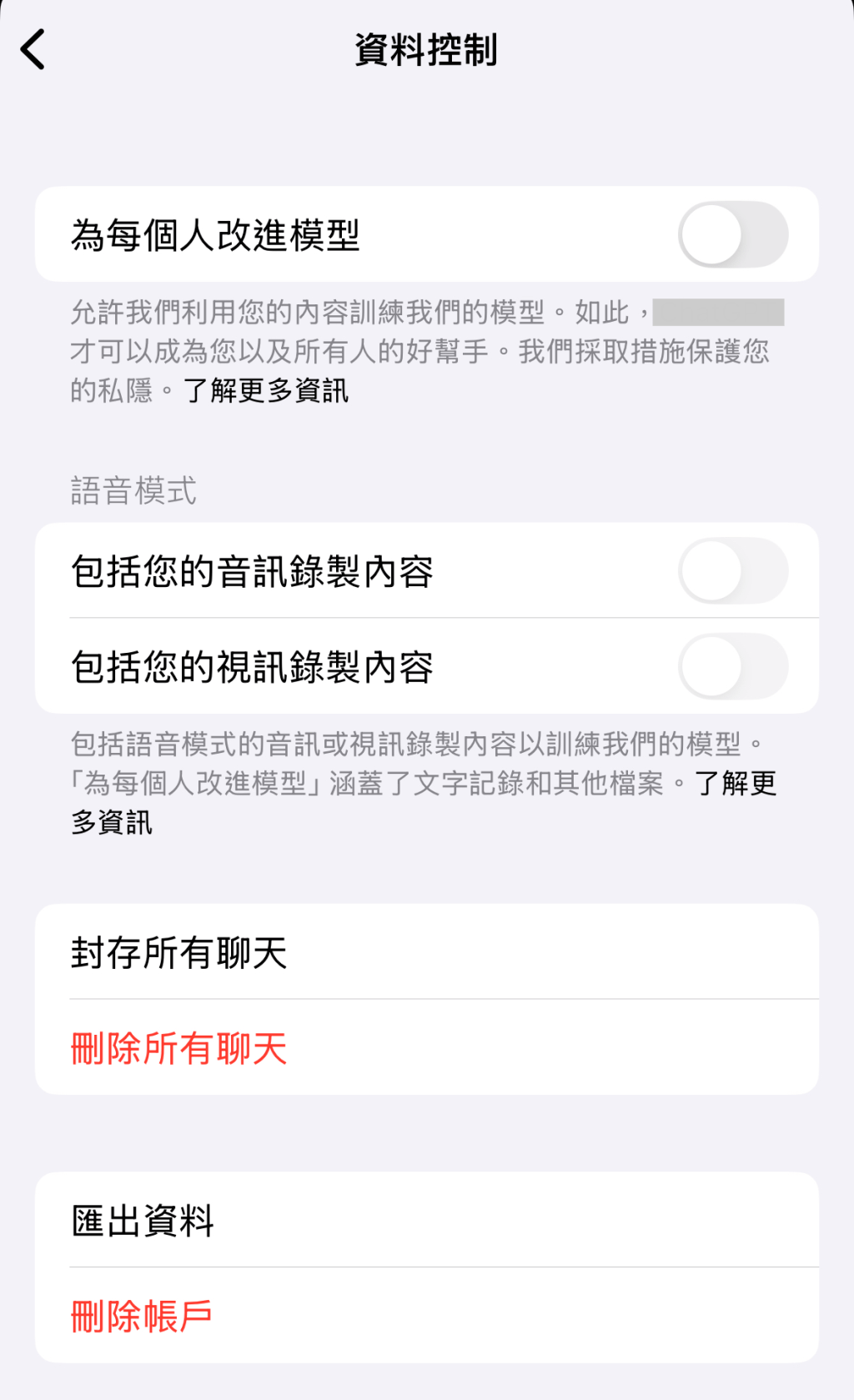

opt-out选项多藏页面深处

事实上,部份AI应用程式并不保证不会将用户上载的内容(如相片、文字)用作训练AI模型之用。有些App虽提供「退出(opt-out)」选项让用户拒绝参与训练,但通常藏身于设定页面深处,甚至根本没有这个选项。换句话说,使用没有安全保障的AI应用程式生成图片或询问问题时,你所上传的内容,可能在不知情下被纳入训练数据之中。如果不希望自己的数据被用作训练AI模型,可以尝试从设定页面查看是否有相关设定,或仔细阅读服务条款。

这种私隐风险,其实早在AI普及前已存在于不少手机应用程式及网上服务中。只是生成式AI的互动性更高,用户往往为了获得回应或出于对AI回答的好奇心,而忽略了背后的条款细节。

需要澄清的是,「成为训练数据」并不等于AI会直接将你的原始内容直接展示给其他用户,而是将其纳入庞大的数据集中(注:大型语言模型通常以数十亿甚至过千亿个参数作训练)。AI模型会从中学习数据的特征,例如图片组成部分,或文字逻辑顺序和语气,从而优化未来的回应,提升整体效能。

或间接构成数据泄露风险

若这些训练资料中包含敏感资料或企业机密,便可能构成间接的数据泄露风险,对企业而言尤其重要。以Microsoft 365 Copilot为例,系统采用严格的「企业数据保护(Enterprise Data Protection)」政策,承诺不会将用户数据用作模型训练,亦透过加密技术保障数据传输安全,并支援稽核功能和Microsoft 365原生的安全控制选项,如敏感度标签,让企业在使用AI时更加安心,同时符合不同的私隐及合规要求。

此外,Microsoft 365 Copilot通过多项国际认证,包括ISO 27001、SOC2 Type 1、GDPR等,进一步保障系统整体的安全性、合规性及数据透明度。

除了技术层面保障,「负责任AI (Responsible AI)的概念亦日益受到重视。Microsoft的Responsible AI框架建基于六大原则:

1. 公平性(Fairness)

2. 可靠性和安全(Reliability & Safety)

3. 隐私权和安全性(Privacy & Security)

4. 包容性(Inclusiveness)

5. 透明度(Transparency)

6. 问责性(Accountability)

在模型训练及回应用户时,这些原则可确保AI回应以人为本、公平中立,避免偏见、歧视或不实回应,并为用户提供完善的治理机制。同时,亦发表《负责任AI透明度报告》,展示其在开发与部署AI技术时,如何透过不同技术和决策实践负责任与道德的原则。

应主动了解AI应用服务条款

作为使用者,我们应主动了解AI应用的服务条款及其对资料的使用方式。例如,许多人会上传个人履历(CV),希望AI协助润饰或翻译,却忽略了当中潜在风险。你有否想过,若该应用程式的条款含糊不清,或未有提供清晰「退出」选项,这份包含姓名、联络方式、学历等个人资料的完整文件,可能会纳入某个语言模型的训练资料之中?

这正是「负责任AI」强调「隐私权和安全性」及「透明度」的重要性,平台应清楚告知数据用途,让用户作出知情选择。因此,使用AI服务时,我们应优先选择信誉良好的平台,留意「数据是否用于模型训练」等条款,并善用「退出」选项。最后,用户的警觉和选择,正是推动科技公司实践「负责任AI的关键力量,亦是共同塑造更安全、更值得信赖AI生态系统的重要一环。

Nora Tam

微软云端策略架构师

注:如有任何疑问,欢迎发送WhatsApp传送讯息至4626 2203